月之暗面近日正式发布了 Kimi K2.6 模型,并继续坚持开源策略。此次更新不仅在编程能力上达到了开源模型的 SOTA(State of the Art)水平,更在多项主流基准测试中超越了 GPT-5.4 和 Claude Opus 4.6 等顶级闭源模型,标志着开源编程模型首次在核心指标上取得压制性优势。

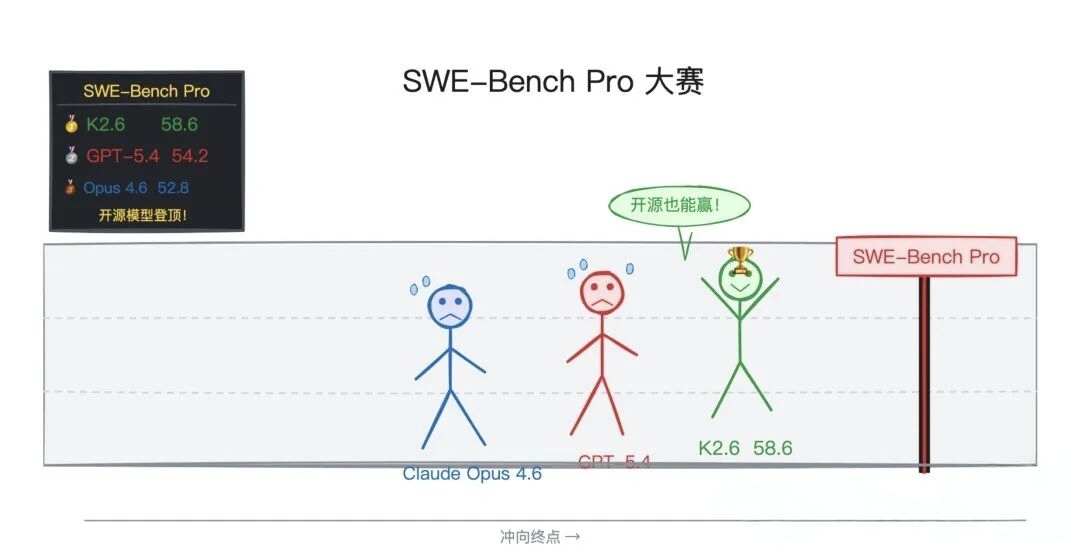

在备受关注的 SWE-Bench Pro 基准测试中,Kimi K2.6 取得了 58.6 分的成绩,超过了 GPT-5.4(xhigh 配置)和 Claude Opus 4.6(max effort 配置)。这一突破对于开源社区而言具有里程碑意义。

核心基准测试表现

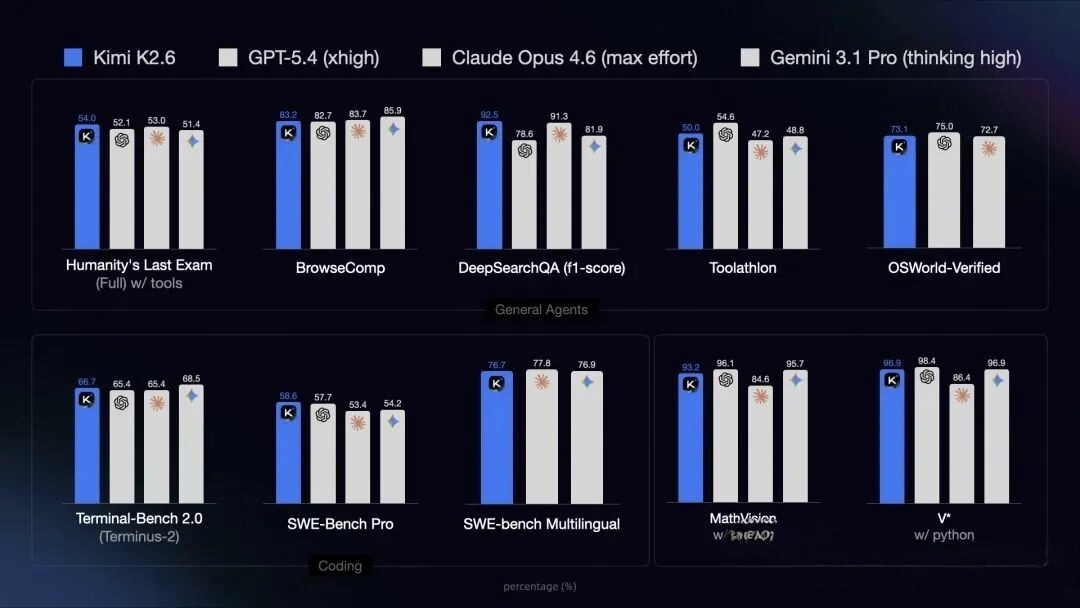

Kimi K2.6 在编程、Agent 任务、数学及视觉等多个维度的基准测试中均表现出色:

- SWE-Bench Pro:58.6(开源模型最高分)

- SWE-Bench Verified:80.2

- SWE-Bench Multilingual:76.7

- Terminal-Bench 2.0:66.7

- HLE w/ tools:54.0

- BrowseComp:83.2

- LiveCodeBench v6:89.6

此外,在数学和视觉领域,该模型在 AIME 2026 中得分 96.4,在 MathVision (with Python) 中得分 93.2,展现了全面的综合能力。

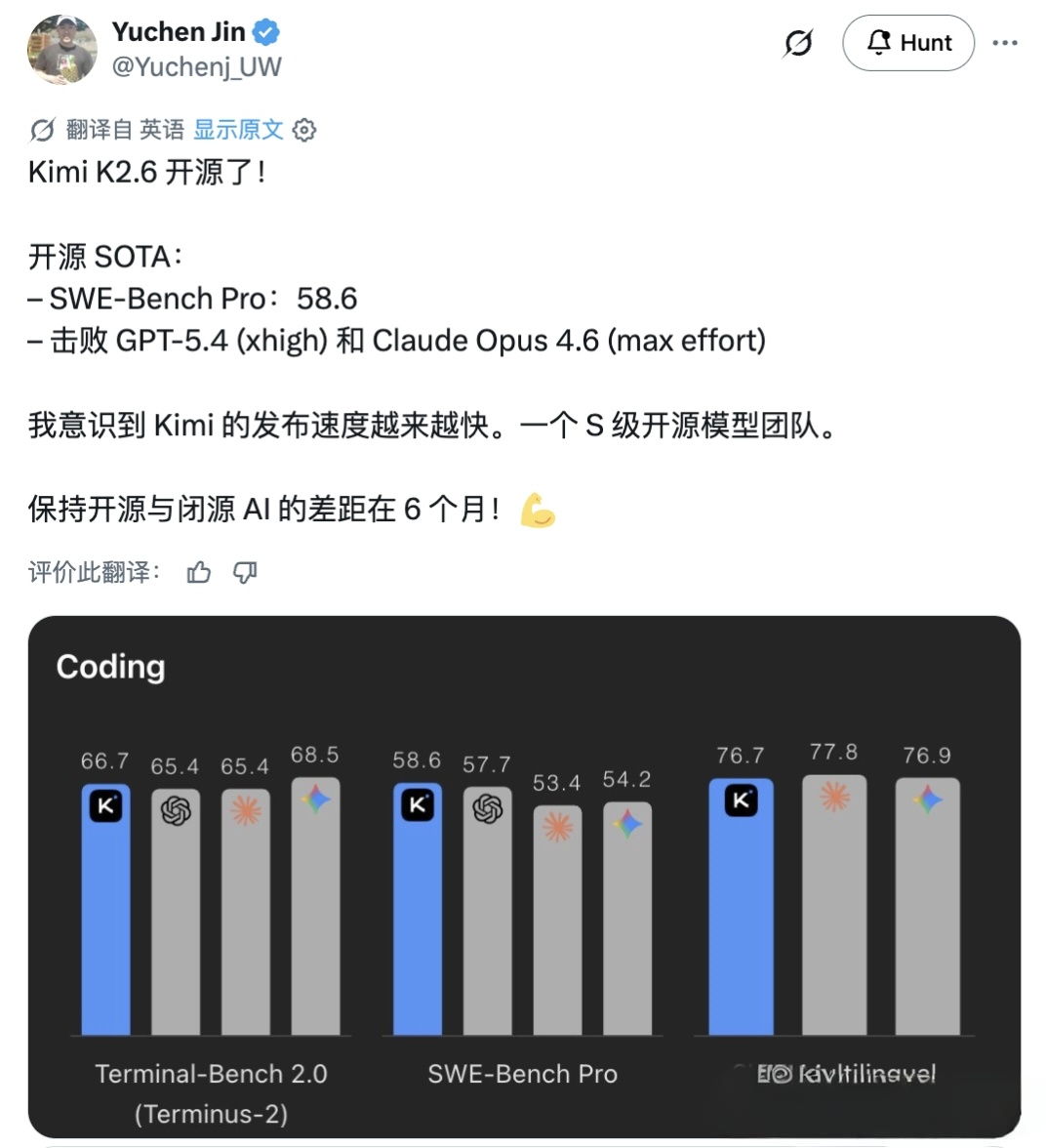

知名开发者 Yuchen Jin 对此评价道:“开源 SOTA!SWE-Bench Pro 58.6,超过了 GPT-5.4 和 Claude Opus 4.6。Kimi 的发布速度越来越快,堪称 S 级的开源模型团队。”

长时程任务稳定性与工程落地能力

除了基准跑分,Kimi K2.6 在真实场景下的长时程工作能力同样值得关注。官方案例显示,该模型能够连续工作 12 小时以上而不出现崩溃或性能衰减。

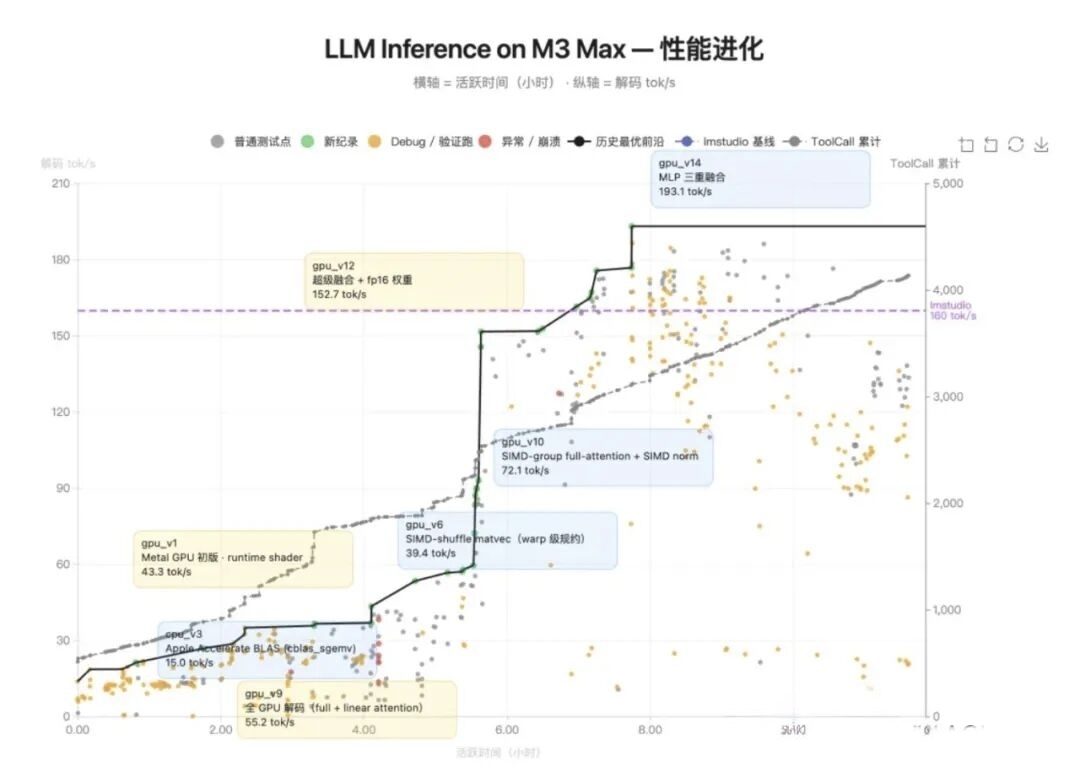

案例一:本地模型部署

在 Mac 环境下使用 Zig 语言本地部署 Qwen3.5-0.8B 模型,整个过程涉及 4000 多次工具调用,跨越 14 轮迭代,持续运行 12 小时。最终推理速度达到 193 tokens/sec,比 LM Studio 快 20%。

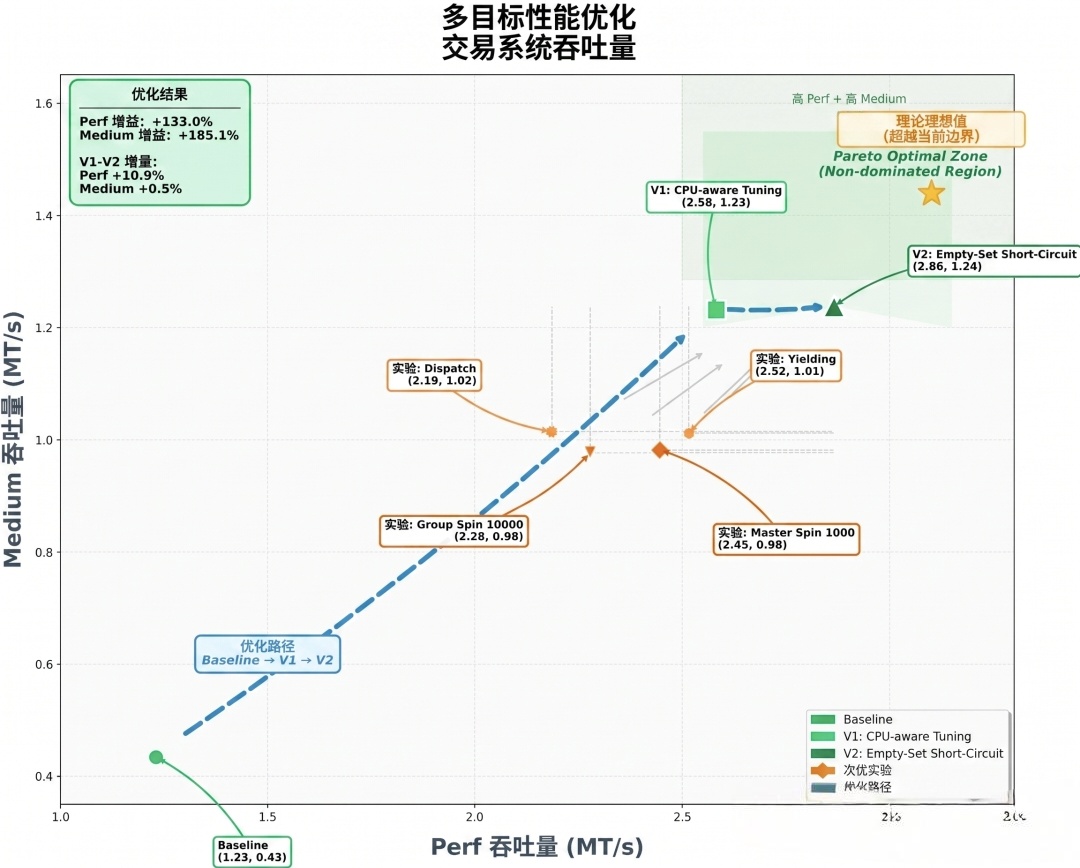

案例二:金融引擎重构

对 exchange-core 金融撮合引擎进行全面重构,耗时 13 小时,执行 1000 多次工具调用,修改代码超过 4000 行。结果显示,中等负载吞吐量提升 185%,整体性能提升 133%。

这些案例证明 Kimi K2.6 具备跨语言(Rust, Go, Python, 前端等)和跨框架的泛化能力,能够像资深工程师一样稳定输出。第三方数据也佐证了这一点:Vercel 报告其在 Next.js 基准上表现提升超 50%;CodeBuddy 报告显示其长上下文稳定性提升 18%,工具调用成功率高达 96.60%。

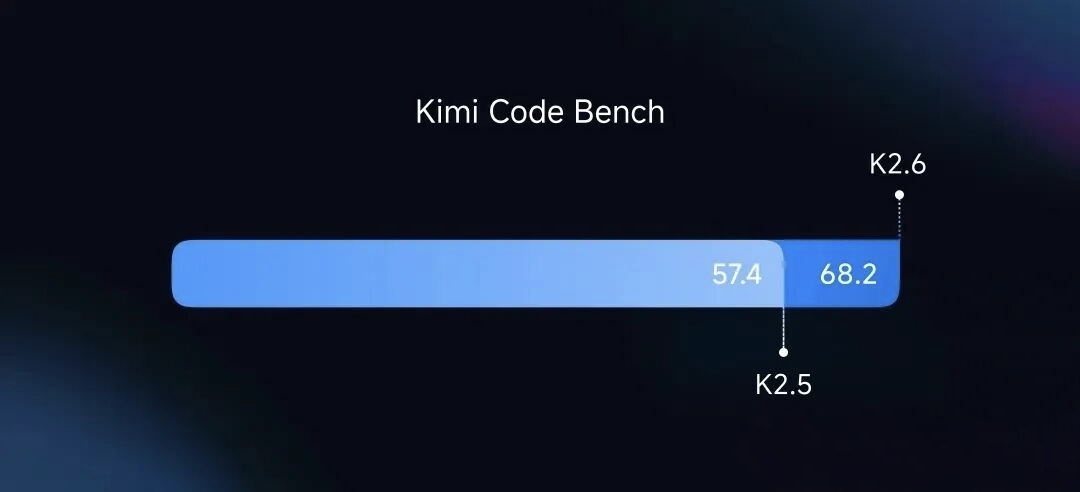

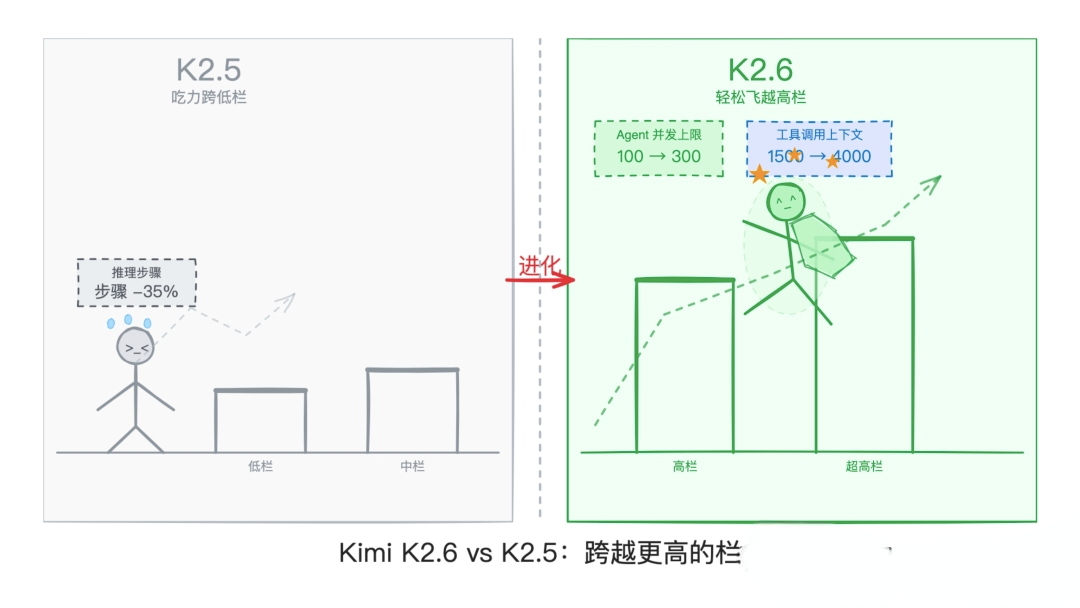

值得注意的是,K2.6 的平均解决步骤数相比 K2.5 减少了约 35%。这意味着更少的 Token 消耗、更低的出错概率以及更快的响应速度。在内部的 Kimi Code Bench 测试中,得分从 57.4 提升至 68.2,涨幅近 20%。

Agent 集群功能升级:300 个智能体并行协作

Kimi K2.6 的另一大亮点是成熟的 Agent 集群功能。用户只需输入一个复杂任务,模型即可自动拆解并创建多个不同角色的“分身”进行并行处理。

相较于 K2.5 版本支持的 100 个子 Agent 和 1500 步上限,K2.6 将这一规格大幅提升至 300 个子 Agent 和 4000 步。这种“一人指令,一支团队”的模式,极大地扩展了模型处理超大规模复杂工程任务的能力边界。

目前,Kimi K2.6 已可通过以下链接体验:

- Kimi 官网:https://kimi.com

- Kimi Code:https://kimi.com/code

【提示】本站只提供资源,不提供技术支持,介意勿下!!

【公告】没有基础小白不要下载,站长不教!!

本站提供的资源,都来自网络,版权争议与本站无关,所有内容及软件的文章仅限用于学习和研究目的。不得将上述内容用于商业或者非法用途,否则,一切后果请用户自负,我们不保证内容的长久可用性,通过使用本站内容随之而来的风险与本站无关,您必须在下载后的24个小时之内,从您的电脑/手机中彻底删除上述内容。如果您喜欢该程序,请支持正版软件,购买注册,得到更好的正版服务。如果有侵权之处请第一时间联系我们删除。敬请谅解

![[精品软件] 乐咔相机V1.00相机功能强大-百云游资源网](https://baiyunyou.com/wp-content/uploads/2021/04/153814eqsommgo8cd6sevs.jpg)

暂无评论内容